چندین شاخص عملکرد وجود دارد که ما آنها را ارزیابی می کنیم، مانند دقت کلی، امتیاز F1، یادآوری و دقت، برای تعیین عملکرد مدل در طبقه بندی مراحل مختلف زوال عقل. امتیاز F1 معیاری است که میانگین وزنی یادآوری و دقت را محاسبه می کند، در حالی که دقت نسبت افراد به درستی طبقه بندی شده را اندازه می گیرد. پس از توسعه مدلها، معیارهای مختلفی به منظور تنظیم پارامترها استفاده شد. برای تعیین عملکرد هر مدل از روش اعتبارسنجی متقابل ۵ برابری استفاده می شود. ارزیابی عملکرد با استفاده از رویکرد چند طبقه ای انجام می شود و با ماتریس سردرگمی نشان داده می شود. در بخش نتایج، ارقام ضرر، دقت، ماتریس سردرگمی و جدول امتیازات طبقهبندی را بر اساس بهترین خروجیهای تاشو از اعتبارسنجی متقابل ۵ برابری برای همه مدلها نمایش میدهیم. به جای نمایش ماتریس از دست دادن، دقت و سردرگمی بهدستآمده از تمام چینهای اعتبارسنجی متقابل ۵ برابری، نمایش بهترین خروجیهای تاشو بهتر است زیرا برای دنبال کردن خروجیهای این مطالعه آشفته نیست. علاوه بر این، پیشبینی مرحله AD و دمانس بسیار مهم است، زیرا داشتن دانش در مورد مرحله به پزشکان این امکان را میدهد تا درک جامعتری از تأثیر بیماری بر بیمار داشته باشند.

۴٫۴٫ معیارهای ارزیابی

برای هر کلاس از مجموعه دادهای که در هر مدل ارائه شد، امتیاز F1 (4)، دقت (۲)، یادآوری (۳) و دقت (۱) را برای ارزیابی عملکرد تکنیکهای پیشنهادی محاسبه کردیم. مثبت واقعی (TP) تعداد تصاویری است که به درستی به عنوان در یک کلاس خاص طبقه بندی شده اند. مثبت کاذب (FP) تعداد تصاویری است که باید به کلاس دیگری تعلق داشته باشند اما به اشتباه به آن کلاس اختصاص داده شده اند. منفی کاذب (FN) تعداد تصاویری است که بخشی از یک کلاس هستند اما به اشتباه به کلاس دیگری اختصاص داده شده اند. تعداد تصاویری که به طور دقیق به عنوان متعلق به یک کلاس متفاوت طبقه بندی می شوند، به عنوان نگاتیو واقعی (TN) در نظر گرفته می شوند.

که در

شکل ۴، مقدار تابع ضرر در برابر تعداد تکرارهای تکمیل شده رسم می شود. هر دو تلفات آموزش و تست برای پنجاه تکرار اول کاهش یافت، حتی اگر تلفات تست پایدار شد. بنابراین، به دلیل پیچیدگی مدل، پس از تقریباً ۵۰ بار تکرار، بین مراحل آموزش و آزمایش انحراف وجود دارد. مدل CNN ظرفیت بالایی برای برازش پارامترهای کافی از داده های آموزشی دارد که مانع از ظرفیت مدل برای تعمیم داده های آزمایشی می شود.

منحنی دقت در مقابل تکرار اطلاعاتی را که برای تایید عملکرد مدل CNN نیاز داریم در اختیار ما قرار می دهد. که در

شکل ۵، می بینیم که هم دقت آموزش و هم تست در حال افزایش است. این نشان میدهد که پیشرفت یادگیری این مدل تا مرز ۱۰۰ تکرار بالا میرود، که فراتر از آن زمانی که آن را برای تعداد بیشتری تکرار اجرا میکنیم، ثابت میماند. بنابراین، در مورد دقت، انحراف زیادی بین مراحل آموزش و تست وجود نداشت.

ماتریس سردرگمی که برای مدل CNN تولید شده است در نشان داده شده است

شکل ۶ برای طبقه بندی طبقات سالم، بسیار خفیف، خفیف و متوسط. با وجود اینکه هیچ پیشبینی درستی از طبقه متوسط وجود ندارد، تعداد موارد کلاس سالم به درستی پیشبینی شده ۴۴۵ است. تعداد موارد کلاس بسیار خفیف به درستی پیش بینی شده ۱۰۰ است. و تعداد موارد کلاس خفیف به درستی پیش بینی شده ۱۶ است. با توجه به اینکه تنها ۶۴ تصویر از کلاس متوسط وجود دارد، پیش بینی دقیق کلاس متوسط دشوار است.

امتیاز F1، دقت، و یادآوری هر یک از کلاسهایی که مدل CNN را تشکیل میدهند به تفصیل در

میز ۱. دقت کلی این مدل ۴۳٫۸۳ درصد محاسبه شده است. امتیاز F1 برای کلاس های سالم، بسیار خفیف، خفیف و متوسط ۰٫۵۹، ۰٫۳۰، ۰٫۱۰ و ۰ است. الگوریتم CNN به درستی ۵۶۱ عکس از ۱۲۸۰ تصویر آزمایشی را پیش بینی کرد. مطابق با

میز ۱مقوله ای که با بیشترین درجه دقت پیش بینی شده بود سالم و دسته ای که با کمترین درجه دقت پیش بینی شده بود دمانس متوسط بود.

که در

شکل ۷، مقدار تابع ضرر در برابر تعداد تکرارهای تکمیل شده رسم می شود. در ابتدا، افت به دلیل پارامترهای تصادفی زیاد بود، اما با افزایش تعداد تکرارها شروع به کاهش کرد. پس از تکرار ۴۰، هر دو تلفات آموزشی و آزمایشی برای VGG16 با لایههای پیچیدگی اضافی پایدار بودند.

ما میتوانیم VGG16 را با عملکرد مدل لایههای پیچیده اضافی از منحنی دقت در مقابل تکرار تأیید کنیم. که در

شکل ۸می بینیم که دقت آموزش و تست حدود ۸۰ درصد است که نشان می دهد پیشرفت یادگیری این مدل تا ۴۰ تکرار در حال افزایش است و پس از آن ثابت می ماند.

که در

شکل ۹ماتریس سردرگمی برای VGG16 با مدل لایه های پیچیده اضافی برای کلاس های سالم، بسیار خفیف، خفیف و متوسط نشان داده شده است. تعداد کلاس های سالم به درستی پیش بینی شده ۵۰۵، کلاس بسیار خفیف ۳۸۳ و کلاس خفیف ۲۳ است، حتی اگر از ۱۳ تصویر آزمون کلاس متوسط، پیش بینی درستی از کلاس متوسط وجود نداشته باشد. از آنجایی که تنها ۶۴ تصویر کلاس متوسط وجود دارد، شانس بسیار کمی برای پیشبینی صحیح کلاس متوسط وجود دارد.

جدول ۲ امتیاز F1، دقت، و فراخوانی تمام کلاسها را برای VGG16 با لایههای کانولوشنال اضافی توصیف میکند. دقت کلی برای این مدل ۷۱٫۱۷ درصد است. امتیاز F1 برای کلاس های سالم، بسیار خفیف، خفیف و متوسط ۰٫۸۳، ۰٫۶۸، ۰٫۲۳ و ۰ است. از ۱۲۸۰ تصویر آزمایشی، مدل ما به درستی ۹۱۱ را پیش بینی می کند.

جدول ۲ نشان می دهد که دقیق ترین کلاس پیش بینی شده سالم است، در حالی که کلاس با کم دقت پیش بینی شده، دمانس متوسط است. از آنجایی که تعداد بسیار کمی از تصاویر کلاس متوسط وجود دارد، عملکرد مدل برای این کلاس بسیار پایین است.

مقدار تابع ضرر در مقابل تعداد تکرارها نشان داده شده است

شکل ۱۰. تلفات مدل GCN برای تصاویر آموزشی و آزمایشی کاهش یافت، حتی اگر در ابتدا تلفات بسیار زیاد بود. پس از تکرار ۱۸، هزینه برای هر دو تصویر آموزشی و آزمایشی در حدود صفر ثابت شد.

منحنی دقت در مقابل تکرار شواهدی را به ما می دهد که برای تأیید کارایی مدل GCN نیاز داریم.

شکل ۱۱ افزایش دقت را در طول آموزش و آزمایش نشان می دهد تا زمانی که نزدیک به ۱ ثابت شود. این نشان می دهد که نرخ یادگیری مدل تا حدود ۲۰ تکرار افزایش می یابد، پس از آن سطح آن کاهش می یابد و ثابت می ماند.

برای طبقه بندی سالم، بسیار خفیف، خفیف و متوسط، ماتریس های سردرگمی حاصل از مدل GCN در نشان داده شده است.

شکل ۱۲. تعداد کل موارد سالم به درستی پیش بینی شده ۶۴۰ است. برای موارد بسیار خفیف، این ۴۴۸ است. و برای موارد کلاس خفیف، این ۱۸۰ است، اگرچه هیچ مورد متوسطی در هیچ یک از ۱۲ تصویر آزمایشی شناسایی نشد. با وجود اینکه مدل GCN قادر به پیشبینی تمام تصاویر دستهبندی دیگر بود، اما قادر به پیشبینی موارد زوال عقل متوسط نبود.

جدول ۳ امتیاز F1، دقت و فراخوانی مدل GCN را برای هر کلاس نشان می دهد. این مدل با دقت جهانی ۹۹٫۰۶ درصد برآورد شده است. امتیاز F1 برای کلاس های سالم، بسیار خفیف، خفیف و متوسط ۱، ۰٫۹۹، ۱ و ۰ است. از مجموع ۱۲۸۰ تصویر آزمایشی، الگوریتم GCN با موفقیت ۱۲۶۸ را پیش بینی کرد. دقیق ترین پیش بینی برای افراد سالم انجام شد. و دسته های خفیف، در حالی که کمترین پیش بینی دقیق برای دسته دمانس متوسط انجام شد.

شکل ۱۳ مقدار تابع ضرر را در مقابل تعداد تکرارها نشان می دهد. حتی اگر در ابتدا تلفات برای تصاویر آزمایشی بسیار زیاد بود، تلفات مدل CNN-GCN برای تصاویر آزمایشی به طور ناگهانی کاهش یافت. پس از چند تکرار اول، هزینه آموزش و آزمایش تصاویر تقریباً صفر شد.

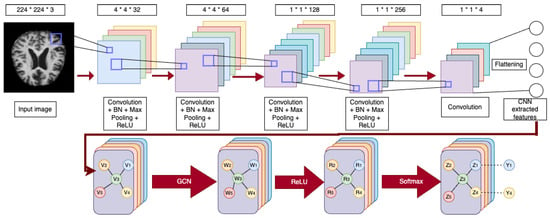

منحنی دقت در مقابل تکرار شواهد لازم برای تایید اثربخشی مدل CNN-GCN را فراهم می کند.

شکل ۱۴ افزایش دقت را در حین تمرین و تست نشان می دهد تا زمانی که به عدد ۱ نزدیک شود و تثبیت شود. این نشان میدهد که نرخ یادگیری مدل پس از چند بار تکرار قبل از تراز کردن و ثابت ماندن افزایش مییابد.

شکل ۱۵ ماتریس های سردرگمی تولید شده توسط مدل CNN-GCN را برای دسته بندی طبقات سالم، بسیار خفیف، خفیف و متوسط نشان می دهد. تعداد موارد سالم به درستی پیش بینی شده ۶۴۱، تعداد موارد بسیار خفیف ۴۴۸، تعداد موارد خفیف ۱۷۹ و تعداد موارد متوسط ۱۲ است. تمامی تصاویر دسته بندی به درستی با استفاده از مدل CNN-GCN پیش بینی می شوند.

جدول ۴ امتیاز F1، دقت و فراخوانی مدل CNN-GCN را برای هر کلاس نشان می دهد. ما دقت کلی ۱۰۰٪ را از مدل CNN-GCN به دست آوردیم. امتیاز F1 برای کلاس های سالم، خیلی خفیف، خفیف و متوسط به ترتیب ۱، ۱، ۱ و ۱ است. الگوریتم CNN-GCN همه ۱۲۸۰ تصویر را با موفقیت پیش بینی می کند.

مدل پیشنهادی ما CNN-GCN به دقت ۱۰۰% در دادههای آموزشی و آزمایشی دست مییابد و ممکن است با ثبت الگوهای نامربوط و غیرعادی، مانند نویز و نقاط پرت، دادههای آموزشی بیش از حد برازش داده شود. در نتیجه، زمانی که با دادههای جدید و ناآشنا ارائه میشود، مدل ممکن است عملکردی زیر همتراز نشان دهد. دقت بالا ممکن است نشان دهنده عدم تعمیم مدل به زمینه ها یا مجموعه داده های جدید باشد. این امر به ویژه هنگام برخورد با داده های مرتبط با سلامت بسیار مهم است زیرا ممکن است تنوع قابل توجهی از خود نشان دهد. از این رو، تأیید صحت مدل CNN-GCN با استفاده از مجموعه دادههای آزمایشی متمایز و اطمینان از کارایی آن در سناریوهای دنیای واقعی به جای تکیه بر تنظیمات آزمایشی کنترلشده، مهم است. بنابراین، ما یک مجموعه داده جداگانه برای اجرای مدل CNN-GCN پیشنهادی خود جمع آوری کردیم. نیرج [

۲۸] مجموعه داده ای را به Kaggle ارائه کرد که شامل تصاویر دوبعدی جمع آوری شده از مجموعه داده های پایه ADNI است که در ابتدا تصاویر Nifti بودند. مجموعه داده دارای سه کلاس مجزا است: AD، MCI و CN. پس از اجرای مدل پیشنهادی CNN-GCN، ماتریس سردرگمی را در آن ارائه کردیم

شکل ۱۶ برای دسته بندی کلاس های AD، MCI و CN. 8 مورد پیشبینی دقیق AD، ۲۱ مورد MCI و ۱۵ مورد CN وجود دارد. مدل CNN-GCN تمام تصاویر دسته بندی را به دقت پیش بینی کرد. این پتانسیل استفاده از آن با داده های جدید و ناآشنا را نشان می دهد.